スペインのバスク大学や英カーディフ大学などに所属する研究者らが発表した論文「Why are all LLMs Obsessed with Japanese Culture? On the Hidden Cultural and Regional Biases of LLMs」は、一部のAIモデルが文化的な話題において日本文化に強い執着を見せることが明らかにした研究報告だ。

近年、大規模言語モデル(LLM)は驚異的な進化を遂げ、多言語で多様なタスクをこなすようになったが、その内面に潜む文化的な偏りについては一部で議論の的となっている。

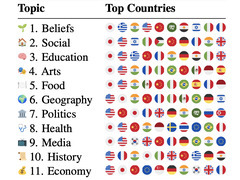

研究チームは、LLMが持つ地域的な偏りを検証するため、「Culture-Related Open Questions」(CROQ)と呼ばれる独自のデータセットを構築した。これは「どのような伝統舞踊が存在するか?」「日常の食事として何が食べられているか?」といった、具体的な国や場所を指定しない質問を24の異なる言語でまとめたもの(1320問×24言語で計3万1680問)である。

研究チームは、モデルに自ら場所を選ばせて回答させることで、AIの内部にある無意識の文化的嗜好をあぶり出そうと試みた。実験には、以下の8つのモデルが使用された。

|

|

|

|

・GPT-4o-mini

・Gemini 2.5 Flash

・Claude 3.5 Haiku

・Llama-4 Maverick

・Command-R 08-2024

|

|

|

|

・Magistral-small-2506

・DeepSeek-v3.2-exp

・Qwen3-next-80b-a3b-instruct

分析の結果、質問された言語が公用語となっている国を回答の舞台に選ぶ傾向が強かった。日本語で質問すれば日本の文化について答え、中国語であれば中国について答えるといった具合だ。特に、インターネット上にある学習データが少ないマイナーな言語ほど、その言語圏の国に固執し、回答の多様性が著しく低下することが分かった。

興味深い発見は、それら入力言語に直接紐づく国を分析対象から除外したときに現れた。この場合、言語やモデルの種類を問わず、AIは一貫して日本と米国を圧倒的な頻度で引き合いに出した。とりわけ日本への偏りは顕著で、評価された8つのモデルのうち6つにおいて、最も参照される国となった。

|

|

|

|

なぜAIはこれほどまでに日本や特定の国の文化に偏ってしまうのか。研究チームは、このバイアスがAIのトレーニングプロセスのどの段階で生じているのかを特定するため、オープンなモデルによる追加実験を行った。

その結果、事前学習の段階にあるベースモデルでは世界中の国々を比較的バランスよく参照し、多様な文化を提示していた。しかし、人間にとって安全で役立つ回答ができるように微調整を施す教師ありファインチューニングの事後学習プロセスを経た途端に、回答の分布が狭まり、日本や米国への強い偏重が生じていた。

一般的に、ファインチューニングなどの事後学習はモデルの有用性を高めるといわれる。一方で文化的な文脈においては、皮肉にも世界の多様な文化を切り捨て、特定の文化を扱う画一化を引き起こしている可能性が示唆された。ただし、追加実験に使ったのは「Llama-3.1 8B」「Gemma2 9B」「Qwen2.5-7B」やその派生モデルなどで、最初の実験と同じではない。

|

|

|

|

|

|

|

|

Copyright(C) 2026 ITmedia Inc. All rights reserved. 記事・写真の無断転載を禁じます。

掲載情報の著作権は提供元企業に帰属します。